Nėra atminties, nėra tęstinumo tarp sąveikos fragmentų raginant. „Paprastai iš vieno epizodo į kitą perkeliama nedaug informacijos arba jos iš viso nėra, o tai užkerta kelią bet kokiam prisitaikymui laikui bėgant“, - rašo Silveris ir Suttonas.

Tačiau jų siūlomame patirties amžiuje „agentai gyvens patirties srautuose, o ne trumpuose sąveikos fragmentuose“.

Silveris ir Suttonas pateikia analogiją tarp srautų ir žmonių, kurie mokosi per visą gyvenimą kaupdami patirtį ir veikia remdamiesi ilgalaikiais tikslais, o ne tik tiesiogine užduotimi.

„Galingi agentai turėtų turėti savo patirties srautą, kuris, kaip ir žmonės, vystosi per ilgą laiko tarpą“, - rašo jie.

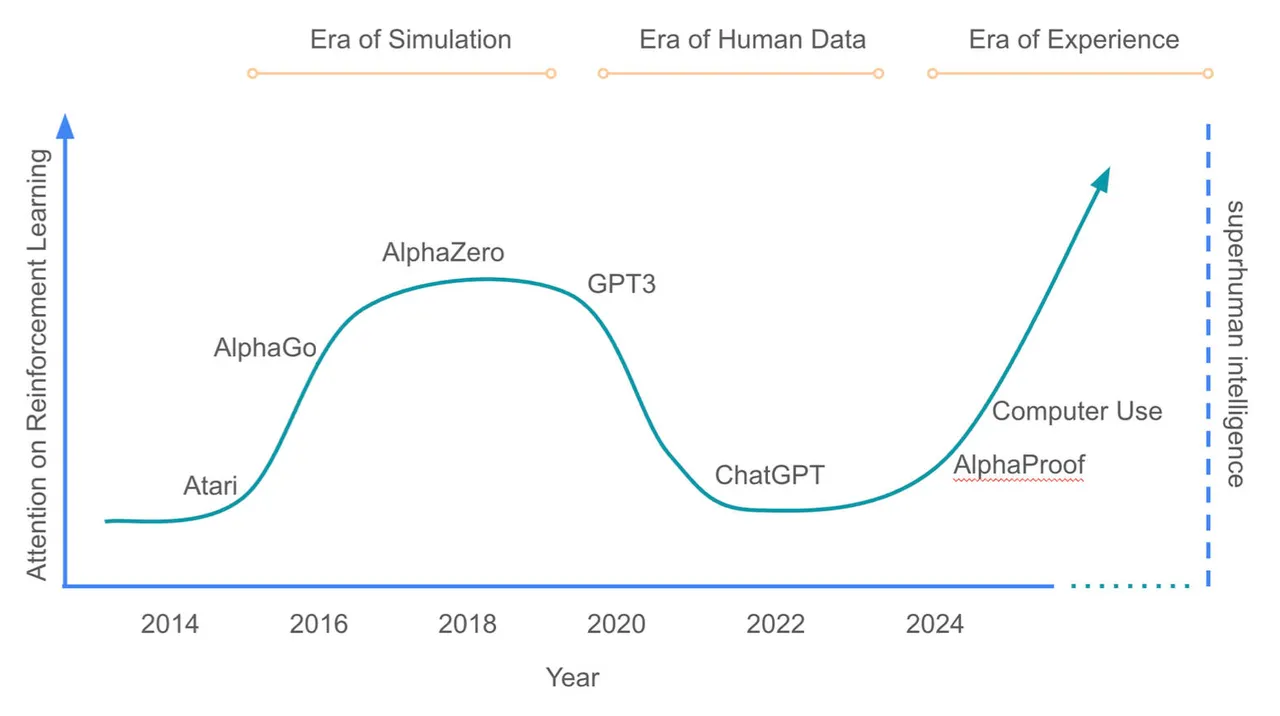

Silveris ir Suttonas teigia, kad „šiandieninių technologijų“ pakanka, kad būtų galima pradėti kurti srautus. Iš tiesų, pirmuosius žingsnius šiame kelyje galima pamatyti tokiuose pasiekimuose kaip interneto naršymo dirbtinio intelekto agentai, įskaitant OpenAI Deep Research.

„Neseniai nauja agentų prototipų banga pradėjo dar bendriau bendrauti su kompiuteriais, naudodama tą pačią sąsają, kurią žmonės naudoja kompiuteriui valdyti“, - rašo jie.

Naršyklės agentas žymi „perėjimą nuo išimtinai žmogaus ir privilegijuoto bendravimo prie daug savarankiškesnės sąveikos, kai agentas gali savarankiškai veikti pasaulyje“.

Silveris ir Suttonas teigia, kad dirbtinio intelekto agentams nebereikia tik naršyti internete, jiems reikia būdo bendrauti su pasauliu ir mokytis iš jo.

Jie siūlo, kad srautuose esantys dirbtinio intelekto agentai mokytųsi pagal tą patį pastiprinto mokymosi principą kaip ir AlphaZero. Mašinai pateikiamas pasaulio, kuriame ji sąveikauja, modelis, panašus į šachmatų lentą, ir taisyklių rinkinys.

Kai dirbtinio intelekto agentas tyrinėja ir atlieka veiksmus, jis gauna grįžtamąjį ryšį kaip „atlygį“. Šie atlygiai moko dirbtinio intelekto modelį, kokie veiksmai yra vertingesni ar mažiau vertingi iš galimų tam tikromis aplinkybėmis.

Silveris ir Suttonas teigia, kad pasaulis yra pilnas įvairių „signalų“, teikiančių šiuos apdovanojimus, jei agentui leidžiama jų ieškoti.

„Iš kur gauti atlygį, jei ne iš žmogaus duomenų? Kai agentai taps susieti su pasauliu per turtingas veiksmų ir stebėjimo erdves, netrūks pagrįstų signalų, kurie suteiks pagrindą atlygiui. Iš tikrųjų pasaulyje gausu tokių dydžių kaip sąnaudos, klaidų lygis, alkis, produktyvumas, sveikatos rodikliai, klimato rodikliai, pelnas, pardavimai, egzaminų rezultatai, sėkmė, apsilankymai, derlius, akcijos, simpatijos, pajamos, malonumas / skausmas, ekonominiai rodikliai, tikslumas, galia, atstumas, greitis, efektyvumas ar energijos suvartojimas. Be to, yra nesuskaičiuojama daugybė papildomų signalų, atsirandančių dėl konkrečių įvykių arba savybių, gaunamų iš neapdorotų stebėjimų ir veiksmų sekų.“

Norėdami pradėti dirbtinio intelekto agentą nuo pagrindo, dirbtinio intelekto kūrėjai gali naudoti „pasaulio modelio“ modeliavimą. Pasaulio modelis leidžia dirbtinio intelekto modeliui daryti prognozes, išbandyti tas prognozes realiame pasaulyje ir tada naudoti atlygio signalus, kad modelis taptų tikroviškesnis.

„Kadangi agentas toliau sąveikauja su pasauliu per visą savo patirties srautą, jo dinamikos modelis nuolat atnaujinamas, kad būtų ištaisytos bet kokios jo prognozių klaidos“, - rašo jie.

Silveris ir Suttonas vis dar tikisi, kad žmonėms teks vaidmuo apibrėžiant tikslus, o signalai ir atlygis padės valdyti agentą. Pavyzdžiui, naudotojas gali nurodyti platų tikslą, pavyzdžiui, „pagerinti savo fizinę būklę“, o atlygio funkcija gali būti naudotojo širdies ritmo, miego trukmės ir nueitų žingsnių funkcija. Arba naudotojas gali nurodyti tikslą „padėti man išmokti ispanų kalbą“, o atlygio funkcija gali grąžinti naudotojo ispanų kalbos egzamino rezultatus.

Žmogaus grįžtamasis ryšys tampa „aukščiausio lygio tikslu“, kuriam tarnauja visa kita.

Tyrėjai rašo, kad tokius toliaregiškus gebėjimus turintys dirbtinio intelekto agentai geriau tiktų kaip dirbtinio intelekto asistentai. Jie galėtų stebėti žmogaus miegą ir mitybą ištisus mėnesius ar metus, teikdami sveikatos patarimus, neapsiribojant naujausiomis tendencijomis. Tokie agentai taip pat galėtų būti švietimo asistentai, stebintys mokinius ilgą laiką.

„Mokslo agentas galėtų siekti ambicingų tikslų, pavyzdžiui, atrasti naują medžiagą arba sumažinti anglies dioksido kiekį“, - siūlo jie. „Toks agentas galėtų ilgą laiką analizuoti realaus pasaulio stebėjimus, kurti ir vykdyti simuliacijas bei siūlyti realius eksperimentus ar intervencijas.“

Tyrėjai teigia, kad „mąstančius“ arba „mąstančius“ dirbtinio intelekto modelius, tokius kaip „Gemini“, „DeepSeek“ R1 ir „OpenAI“ o1, gali pralenkti patirties agentai. Mąstymo agentų problema yra ta, kad jie „imituoja“ žmogaus kalbą, kai pateikia daugtaškius rezultatus apie žingsnius iki atsakymo, o žmogaus mąstymą gali riboti jame įtvirtintos prielaidos.

„Pavyzdžiui, jei agentas būtų buvęs išmokytas samprotauti naudojant žmogaus mintis ir ekspertų atsakymus prieš 5000 metų, jis galėjo samprotauti apie fizikinę problemą animizmo terminais“, - siūlo jie. „Prieš 1 000 metų jis galėjo samprotauti teistiniais terminais, prieš 300 metų - Niutono mechanikos terminais, o prieš 50 metų - kvantinės mechanikos terminais.“

Tyrėjai rašo, kad tokie agentai „atskleis neregėtų galimybių“, o tai lems „ateitį, kuri smarkiai skirsis nuo visko, ką matėme iki šiol“.

Tačiau jie teigia, kad yra ir daug, labai daug pavojų. Ši rizika susijusi ne tik su tuo, kad dirbtinio intelekto agentai pavers žmonių darbą nebereikalingu, nors jie pažymi, kad darbo vietų praradimas yra rizika. Jie rašo, kad agentai, kurie „gali savarankiškai sąveikauti su pasauliu ilgesnį laiką siekdami ilgalaikių tikslų“, kelia perspektyvą, kad žmonės turės mažiau galimybių „įsikišti ir tarpininkauti agento veiksmams“.

Teigiama, kad agentas, kuris gali prisitaikyti, priešingai nei šiandieniniai fiksuoti dirbtinio intelekto modeliai, „galėtų atpažinti, kada jo elgesys sukelia žmogaus susirūpinimą, nepasitenkinimą ar kančią, ir adaptyviai keisti savo elgesį, kad išvengtų šių neigiamų pasekmių“.

Nesigilindami į detales, Silveris ir Suttonas įsitikinę, kad srautai suteiks tiek daug informacijos apie pasaulį, kad ji pranoks visus „Wikipedia“ ir „Reddit“ duomenis, naudojamus šiandieniniam dirbtiniam intelektui mokyti. Srautais grindžiami agentai gali net pranokti žmogiškąjį intelektą, o tai reiškia, kad atsiras dirbtinis bendrasis intelektas, arba superintelektas.

„Patirčių duomenys savo mastu ir kokybe pralenks žmogaus sukurtus duomenis“, - rašo tyrėjai. „Šis paradigmos pokytis, lydimas algoritminės pažangos RL [pastiprinto mokymosi] srityje, daugelyje sričių atskleis naujus gebėjimus, kurie pranoks bet kurio žmogaus turimus.“