Anthropic panaikino papildomą mokestį už milijoninius kontekstus. Opus 4.6 ir Sonnet 4.6 tapo dvigubai pigesni

Data: 2026 m. kovo 18 d.

Pasaulyje, kur kiekvienas tokenas kainuoja pinigų, Anthropic netikėtai atpigino ilgų užklausų apdorojimą – ir tai keičia žaidimo taisykles kūrėjams, dirbantiems su milžiniškais failais

Kovo 14 dieną Anthropic paskelbė, kad 1 milijono tokenų konteksto langas Claude Opus 4.6 ir Sonnet 4.6 modeliams dabar pasiekiamas visiems, su standartine kainodara, pakeičiančia anksčiau taikytą priemoką. Tai reiškia vieną paprastą dalyką: 900 000 tokenų užklausa apmokestinama tuo pačiu tarifu kaip 9 000 tokenų.

Ankstesnėje kainų sistemoje vis buvo velnias. Sonnet įvesties kaina šokdavo nuo ~3 USD iki ~6 USD už milijoną tokenų, kai užklausos viršydavo 200 000 tokenų ribą, o Opus kaina kildavo nuo ~5 USD iki ~10 USD. Išvesties tokenų tarifai taip pat dvigubėdavo. Dabar ši sistema panaikinta – nėra slenkščių, nėra staigmenų.

Kodėl tai svarbu kūrėjamsKonteksto langas – tai AI atminties ribos. Jame telpa visa, ką modelis „prisimena" konkrečioje užklausoje: jūsų klausimas, dokumentai, kodas, ankstesni atsakymai. Milijono tokenų langas – tai maždaug 750 000 žodžių, arba visa Harry Potter serija viename pokalbyje.

Opus 4.6 yra Anthropic flagmanas įmonių darbo krūviams, kuriems reikalingas nuoseklus samprotavimas didelėse duomenų bazėse ir sudėtingose programavimo užduotyse, o Sonnet 4.6 – efektyvesnis universalus modelis, skirtas didelio našumo kūrėjų poreikiams ir produkciniams scenarijams.

Iki šiol šis langas turėjo dvi kainas: standartinę (iki 200k tokenų) ir premium (virš 200k). Tai vertė kūrėjus vaikščioti pusiausvyros lentu arba taikyti sudėtingus architektinius sprendimus, kad išvengtų sąskaitų šoko.

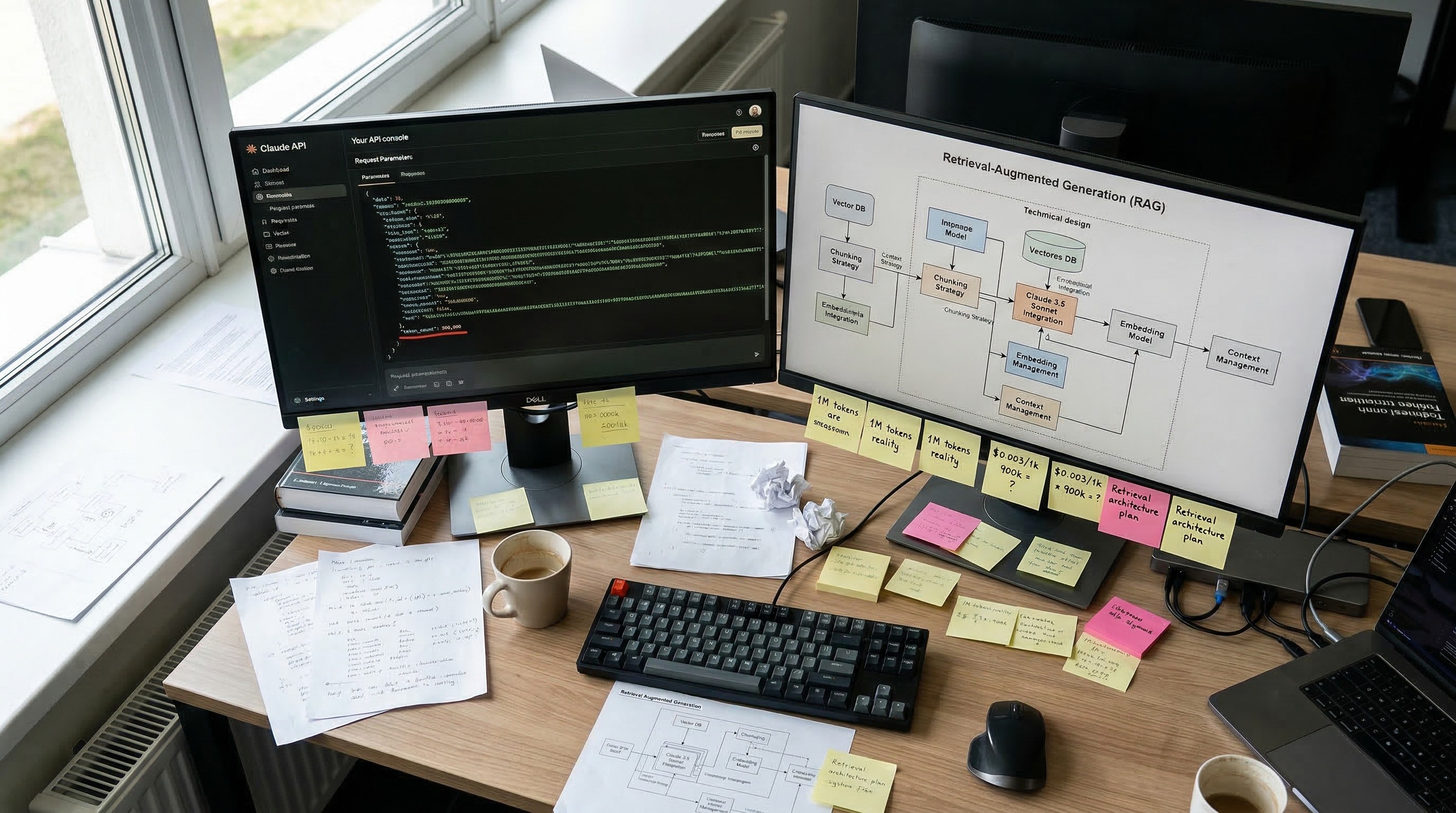

Retrieval sistemos – kurios ištraukia tik aktualiausius duomenų fragmentus – tapo įprastu architektūriniu modeliu iš dalies todėl, kad siųsti labai dideles užklausas galėjo greitai tapti brangu.

Dabar apribojimai išnyko. Opus 4.6 ir Sonnet 4.6 apima pilną 1M tokenų konteksto langą standartiniu tarifu, ir prompt caching bei batch processing nuolaidos taikomos standartiniais tarifais visame konteksto lange.

Kas pasikeitė techninėje pusėjeKompanija pristatė abu modelius per kelias savaites vasario mėnesį. Opus 4.6 išėjo vasario 5-ąją, Sonnet 4.6 – vasario 17-ąją. Jie pirmi iš Opus klasės modelių turėjo 1M konteksto galimybę, bet su ta premija.

Kaip veikia? Dabar kaina už Opus 4.6 yra ~5 USD už milijoną įvesties tokenų ir ~25 USD už milijoną išvesties tokenų, o Sonnet 4.6 kainuoja ~3 USD už milijoną įvesties tokenų ir ~15 USD už milijoną išvesties tokenų.

500K tokenų Opus užklausa, kuri anksčiau kainavo 5.00 USD įvesties tokenais, dabar kainuoja 2.50 USD. Darbo krūviams, kurie reguliariai viršija 200K tokenų – teisinių dokumentų analizei, kodo bazių tyrimui, mokslinių tyrimų sintezei – tai perpus sumažina įvesties kainą ir trečdaliu išvesties.

Kas laimėjo konteksto karą?Anthropic nebuvo pirmieji su milijonu tokenų. Google ir OpenAI jau buvo pristatę modelius, galinčius apdoroti beveik milijono tokenų užklausas. Bet Claude dabar vienintelis modelių šeima, kurioje du stipriausi lygmenys (Opus ir Sonnet) siūlo 1M kontekstą su vienoda kainodara.

OpenAI GPT-5.4 dvigubina kainą, kai peršoki 272 000 tokenų. Ta priemoka įsijungia automatiškai, taikoma visai sesijai atgaline data, ir daug kūrėjų tai užklumpa netikėtai. Anthropic tą trinties tašką pašalino visiškai.

RAG vs ilgas kontekstas – išlieka spragųMilijoninis kontekstas atrodo įspūdingai, bet jis turi slaptų problemų. Tas pats 100% pasklinda milijonui kandidatų. Svarbus dalykas (jei jis viduryje) dabar turi konkuruoti su masyviu kiekiu supančio teksto dėl modelio dėmesio, ir dažnai pralaimi.

Opus 4.6 pasiekia 76% MRCR v2 teste (8-needle, 1M tokenų), kai Sonnet 4.5 pasiekia tik 18.5%. Tai koks keturių kartų proveržis. Bet context rot – tai reali problema: Kai tokenų skaičius auga, tikslumas ir atšaukimas blogėja – reiškinys vadinamas konteksto gedimas. Tai daro tai, kas yra kontekste, kaip svarbu, kiek erdvės yra.

Tyrimai rodo, kad kai ištekliai suteikiami pakankamai, ilgo konteksto sprendimas nuosekliai lenkia RAG vidutinio našumo atžvilgiu. Tačiau RAG žymiai mažesnė kaina išlieka aiškus pranašumas.

Platesnė perspektyva

Ši priemonių panaikinimo strategija ne atsitiktinė. Produkto strategija aiški: sujungiamas lygus kainodaros modelis su geresniu ilgo konteksto prisiminimu ir dominuojama produkciniuose AI darbo eigose.

Konteksto langas pasiekiamas Claude Platform natūraliai ir per Amazon Bedrock, Google Cloud Vertex AI ir Microsoft Foundry. Claude Code Max, Team ir Enterprise vartotojams, naudojantiems Opus 4.6, bus automatiškai suteiktas pilnas 1 milijono tokenų konteksto langas.

Tai taip pat keičia, kaip kūrėjai projektuoja sistemas. Brad Feld, Techstars bendraturis, rašo: "Pašalinęs ilgo konteksto priemoką, gali paveikti, kaip kuriamos programos. Retrieval sistemos – kurios ištraukia tik aktualiausius duomenų fragmentus – tapo įprastu architektūriniu modeliu iš dalies todėl, kad siųsti labai dideles užklausas galėjo greitai tapti brangu. Su premium pakopos panaikinimu, to apribojimo nebėra. Kūrėjai vis dar gali pasikliauti retrieval sistemomis, bet gali pasirinkti siųsti didesnius informacijos blokus tiesiogiai modeliui".

Ponas Obuolys sakoAnthropic čia sužaidė protingai: panaikino priemoką būtent tada, kai visi išmoko su ja gyventi. Bet nepamirškite – milijoninio konteksto langas nereiškia, kad turite į jį visko kimšti. Context rot – tai tikra problema, o retrieval sistemos neišnyks dėl aiškios priežasties: jos vis dar pigesnės ir greitesnės daugeliu atvejų.

Ironija: dabar kainuoja tiek pat paprasta užklausa ir ta, į kurią įkrovei pusę GitHub repo, bet atsakymas nėra 100% tikslus. Taigi toks milijoninis kontekstas – tai tarsi turėti daug atminties, bet truputį miglotos.

---

Šaltiniai: The New Stack, Anthropic API Docs, Medium (Joe Njenga), Awesome Agents, Karol Zieminski Substack, The Decoder